De fleste virksomheter ser betydelige gevinster ved å ta i bruk AI.

Dette var temaet for webinaret somNettverk teknologi- og sikkerhet inviterte til i samarbeid med KPMG for å ta en titt inn i fremtiden.

Om du gikk glipp av webinaret kan du lese en kort oppsummering temaene som ble belyst nedenfor. Du kan laste ned foiler og se opptaket fra webinaret HER (kun for medlemmer).

Framtidens risk- og compliancefunksjon

KPMGs undersøkelser viser at de fleste virksomheter ser betydelige gevinster ved å ta i bruk AI, og at teknologien kan være en viktig bidragsyter til å redusere kostnadene forbundet med disse funksjonene framover.

Gisle Nerbråten redegjorde for hvordan anvendelse av AI i risiko- og compliance-funksjonen er essensiell for å kunne:

- Sørge for at risikostyringsløsningene kontinuerlig tilpasses for å møte nye risikoeksponeringer på en optimal måte.

- Forbedre og effektivisere vurderings- og kontrollarbeidet

- Fungere som en brobygger mellom forretning og IT slik at implementeringen blir vellykket.

AI muliggjør dynamisk risikomodellering og sanntidsrisikoanalyse som gir umiddelbare innsikter i fremvoksende risikoer. AI-drevet automatisering effektiviserer prosessene for compliance-overvåking og risikovurdering, og reduserer dermed manuelt arbeid og feilrater betydelig. Ved hjelp av AI kan risikostyring desentraliseres, noe som gir mer fleksible og raske tilpasninger på tvers av virksomheten.

Framtidens internrevisjonsfunksjon

Kenneth Hansen og Tommy Knutsen forklarte hvordan digital transformasjon, økte regulatoriske krav og geopolitisk usikkerhet gjør internrevisjonsarbeidet mer komplekst enn tidligere.

For å møte disse utfordringene må internrevisjonen derfor utvikle seg fra å være en ren kontrollfunksjon til å bli en strategisk verdiskaper. Dette kan man oppnå gjennom å integrere bruk av AI og dataanalyse i prosessene slik at man kan identifisere og mitigere risiko proaktivt.

Ansvarlig bruk av AI og internrevisors integritet må vurderes kontinuerlig.

Formålet er at AI skal bidra til økt kvalitet og ikke bare økt effektivitet.

Hvordan sikre at AI-modeller er pålitelige?

Thor Aage Dragsten forklarte at økt bruk av ny teknologi fører til nye typer risikoer og at formålet med AI Act er å beskytte enkeltpersoner og samfunnet mot risikoer som oppstår ved bruk av kunstig intelligens. Loven setter derfor krav til grundige tiltak knyttet til høyrisiko-tilnærminger, spesielt innen styring, validering og etterlevelse.

For å øke tilliten til AI og sikre at det produseres pålitelige resultater for brukeren er det derfor viktig å:

- Kartlegge og risikoklassifisere AI-modeller som anvendes

- Gjennomføre modenhetsvurderinger av internkontrollrammeverk for AI

- Gjennomføre modelltesting og algoritmerevisjoner

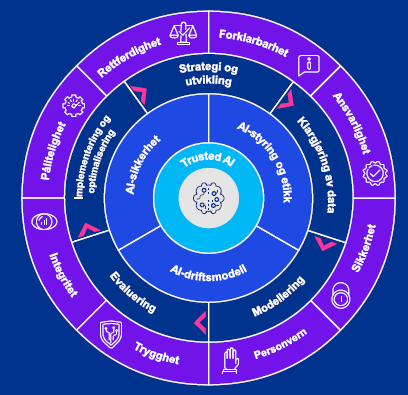

KPMGs rammeverk «Trusted AI» bygger på åtte pilarer som skal hjelpe virksomheter med å imøtekomme regulatoriske krav og å styre AI-relatert risiko og som er illustrert i den ytre sirkelen i figuren nedenfor:

Kilde: KPMG 2025