Hvor intelligent kan KI bli? Kan man lære KI folkeskikk? Og hvilke risikoer bør ledelsen og vi som internrevisorer være opptatt av når virksomhetene våre tar i bruk KI-verktøy?

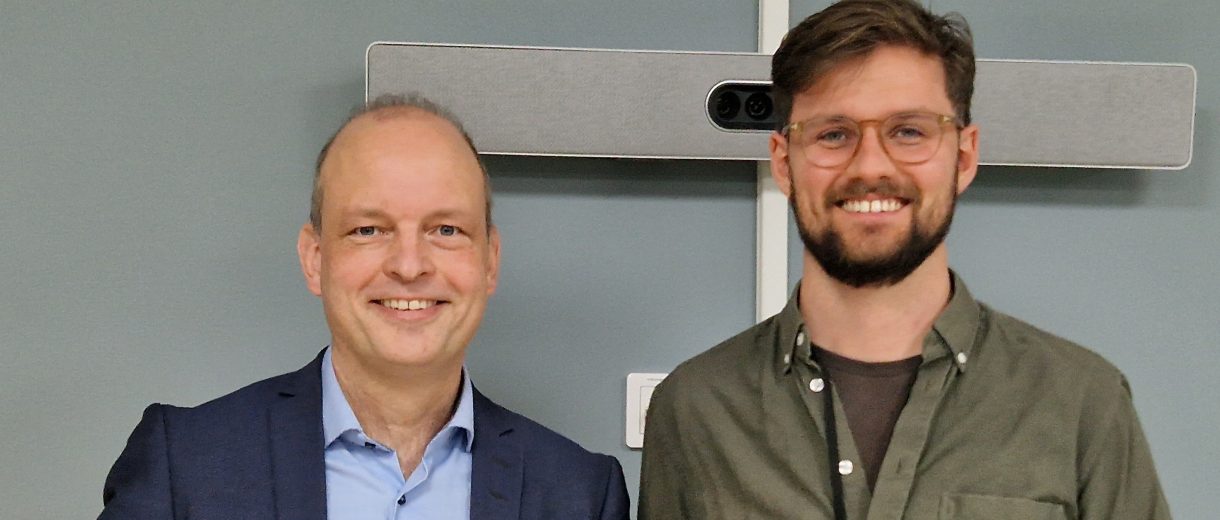

Dette var noen av temaene som ble tatt opp på nettverkssamlingen til nettverk for internrevisjon i offentlig virksomhet, som ble holdt 22. november i lokalene til DFØ på Økern. Nettverket hadde invitert Henrik Slettene fra Inmeta Consulting og Jens Andresen Osberg fra Digitaliseringsdirektoratet (Digdir) til å belyse problemstillinger rundt KI fra ulike perspektiver.

Hva kan KI brukes til?

Henrik Slettene var opptatt av at KI ikke må ses på som et rent IT-verktøy, men utvikles og tas i bruk av forretningssiden for å løse problemer, utnytte muligheter og skape produkter. Han kunne berolige forsamlingen med at KI ikke kan erstatte menneskers evne til intuisjon, kreativitet, planlegging og logisk tenkning. Derimot kan KI hjelpe oss med å prosessere data, finne mønstre, gjøre avanserte beregninger og være objektiv.

En av de vanligste måtene å utvikle kunstig intelligens på er gjennom maskinlæringsteknikker, hvor maskinene trenes ved bruk av historiske data. KI kan tilpasse seg til observasjoner og endringer i omgivelsene, og på den måten framstå som klokere enn mennesker. Dette gjelder for eksempel innenfor bildegjenkjenningsteknologi i dag. Men KI har verken ønsker eller mål, og kan ikke brukes til å forklare hvordan ting henger sammen eller hvorfor ting skjer.

Hvordan virker teknologi som ChatGPT?

Et av de eksemplene på KI som vi kjenner best i dag er ChatGPT. Dette verktøyet er basert på språkmodeller som kjennetegnes av at de analyserer hvilke ord som ofte opptrer sammen, og kan predikere sannsynligheten for hvilket ord som blir det neste i en setning. Ut fra kontekstopplysninger og regnekraft kan ChatGTP prosessere og systematisere store mengder informasjon.

Kan ChatGPT lære folkeskikk?

Når språkmodeller baserer seg på historiske data kan vi også risikere at modellene gjenskaper utfall som ikke er i tråd med våre verdier eller ønsket praksis. Det finnes eksempler på at språkmodeller kan hallusinere og presentere resultater som ikke er basert på faktiske hendelser. Av denne grunn må språkmodellene trenes opp til å bli ‘helpful, harmless and honest’, slik at vi unngår uheldige eller uønskede utfall av teknologien.

Veileder for ansvarlig utvikling og bruk av KI i offentlig sektor

Jens Andresen Osberg viste til at vi allerede har noen lover som gjelder for, og regulerer, KI. Det gjelder for eksempel forvaltningsloven, personvernloven og lov om likestilling og forbud mot diskriminering. Den foreslåtte KI-forordningen fra EU vil sannsynligvis også bli tatt med i norsk lovverk gjennom EØS-avtalen. Dette kan bidra til etablering av standarder som kan redusere noe av risikoen på området.

Han så likevel utfordringer knyttet til å sikre brukerens rett til begrunnelser for vedtak når offentlige virksomheter tar i bruk KI. For å tette dette gapet har Digdir har laget en veileder for ansvarlig bruk av KI i offentlig sektor. Veilederen tar blant annet for seg temaer som risikovurderinger og opplæring før generativ KI tas i bruk, og samhandling med innbyggerne og metodiske utfordringer i forbindelse med innføring av KI. Veilederen følger eksisterende og kommende regelverk tett, der innspill kan være med å forme veilederen framover.

Kva er egentlig kunstig intelligens?

Kilde: Digital Norway / tema / kunstig intelligens